Google ist die Kern-Tochtergesellschaft von Alphabet Inc. und hat sich weit über die Suche hinaus entwickelt, um zu einem der größten Technologie-Ökosysteme der Welt zu werden. Seine Arbeit erstreckt sich über Software, Werbung, mobile Plattformen, Cloud-Computing, Hardware und fortgeschrittene

künstliche Intelligenz. Die Mission des Unternehmens, Informationen zu organisieren, hat sich dahingehend entwickelt, Produkte und Infrastrukturen zu schaffen, die bestimmen, wie Milliarden von Nutzern täglich mit Technologie interagieren.

1. Googles Verbraucher- und Werbungsproduktlinie bleibt sein größtes Geschäftssegment. Dazu gehören Google Search, die weltweit am häufigsten verwendete Suchmaschine; YouTube, ein globaler Marktführer bei Videoinhalten und digitaler Werbung; und Android, das am weitesten verbreitete mobile Betriebssystem weltweit. Zusammen verankern diese Plattformen Googles Werbeeinnahmen und definieren seine globale Reichweite.

2. Googles Unternehmens- und Infrastrukturproduktlinie unterstützt Unternehmen, Entwickler und Organisationen weltweit. Dieses Segment umfasst Google Cloud, das Cloud-Computing, Datenanalytik und KI-Infrastruktur bereitstellt; Google Workspace, die Produktivitätssuite mit Gmail, Docs, Sheets und Drive; und die Pixel- und Nest-Hardware-Linien des Unternehmens, die KI-Funktionen in Smartphones und Smart-Home-Geräte integrieren. Es umfasst auch Google Research und DeepMind, die grundlegende Technologien vorantreiben, die im breiteren Produktökosystem des Unternehmens verwendet werden.

3. Googles KI-Produktlinie wird zunehmend zentral für seine langfristige Strategie.

• Gemini 3.0, Googles neuestes multimodales KI-Modell, das in Search, Workspace und Android verwendet wird

• Gemini Advanced und Gemini for Enterprise, Abonnement-KI-Dienste für Einzelpersonen und Organisationen

• KI-Agenten und Entwicklertools, die mit Google Cloud, Workspace und mobilen Plattformen integriert sind

• DeepMinds angewandte KI-Systeme, die Optimierung, Sicherheitsforschung und entstehende Agenten-Fähigkeiten antreiben

Obwohl Google KI nicht als eigenständige Umsatzkategorie ausweist, treibt KI einen wachsenden Anteil der Cloud- und Produktnutzung voran, und viele neue Funktionen in Googles Ökosystem basieren direkt auf Gemini-basierten Modellen.

Google vs. Nvidia vs. OpenAI: Wer gewinnt das KI-Rennen 2025?

Das KI-Rennen 2025 wird nicht von einem einzigen Spitzenreiter definiert, sondern von drei Unternehmen, die das Feld aus verschiedenen Blickwinkeln vorantreiben. Google prägt, wie KI Milliarden von Nutzern erreicht,

Nvidia liefert die Rechenleistung, die die meisten modernen Modelle trainiert, und OpenAI treibt den schnellen Fortschritt in der Modellentwicklung voran. Ihre Rollen überschneiden sich, dennoch führt jedes in einem anderen Teil der Landschaft.

Gesamt: Googles integriertes Ökosystem verschafft ihm einen strategischen Vorteil

Googles Stärke in 2025 kommt von einem eng verbundenen KI-Stack. Google DeepMind entwickelt die Modelle, Alphabet betreibt TPU-betriebene Rechenzentren, und das Unternehmen setzt KI in Search, YouTube, Android, Workspace und Cloud ein. Diese Abstimmung ermöglicht es Google, sein gesamtes Ökosystem durch eine einzige Modellplattform zu aktualisieren.

Nvidia führt KI-Computing mit seinen GPUs an, betreibt aber keine verbrauchermaßstäblichen KI-Produkte. OpenAI bewegt sich schnell in der Modellentwicklung, ist aber auf externe Cloud und Hardware angewiesen. Microsoft treibt Unternehmens-KI durch Azure voran, hat aber keine vollständige Kontrolle über den Modell-Stack und mobile Verteilung. Google bleibt das einzige Unternehmen, das interne Modellforschung, proprietäre Hardware und sofortigen Zugang zu Milliarden von Nutzern kombiniert.

Modellvergleich: Google priorisiert Ökosystem-Integration, während KI-Labs frei konkurrieren

Gemini 3.0 treibt Googles Hauptprodukte an, von Search und Workspace bis Android und Pixel. Anstatt um Benchmark-Siege zu kämpfen, konzentriert sich Google darauf, Gemini in tägliche Arbeitsabläufe einzubetten, was dem Modell breite, stabile Nutzung verschafft, auch wenn es nicht der Top-Performer in jedem Test ist.

Andere führende Modelle im KI-Wettbewerb

• Gemini 3.0 (Google) optimiert für multimodales Reasoning und integrierte Produkterlebnisse.

• Claude (Anthropic) stark in strukturiertem Reasoning und sicherheitsorientierten Unternehmensaufgaben.

• Perplexity Model (Perplexity AI) entwickelt für Abrufgenauigkeit und suchähnliche Antworten.

• DeepSeek V3.1 (DeepSeek Labs) effektiv in technischem Reasoning und bestimmten Handels-Simulationen.

• GPT-5 Serie (OpenAI) weit verbreitet durch ChatGPT, APIs und Agenten-Workflows.

• Grok-4 (xAI) gebaut für Echtzeitdatenzugang und schnelle Iteration.

Eine interessante Episode kam aus dem Alpha Arena Experiment auf

Perp Dex Hyperliquid, wo jedes Modell zehntausend Dollar erhielt, um Krypto-Perpetuals zu handeln. Nach zweiundsiebzig Stunden verbuchten DeepSeek V3.1 und Grok-4 Gewinne über vierzehn Prozent, während GPT-5 und Gemini 2.5 Pro Verluste verzeichneten. Die Ergebnisse spiegeln die Leistung in diesem spezifischen Setup wider und sollten nicht als allgemeines Ranking der Modellfähigkeiten betrachtet werden.

Trotz intensiver Konkurrenz zwischen Modell-Labs bleibt Googles Stärke seine Fähigkeit, Gemini in Produkten einzusetzen, die täglich von Milliarden genutzt werden.

Hardware-Vergleich: Nvidia führt Computing an, während Google interne Skalierung optimiert

Google trainiert und betreibt Gemini mit Tensor Processing Units (TPUs), die für effiziente groß angelegte Arbeitslasten in seiner eigenen Infrastruktur entwickelt wurden. TPUs geben Google Kontrolle über Kosten und Leistung, obwohl sie außerhalb des Unternehmens nicht weit verbreitet sind.

Wie sich Hardware-Strategien unterscheiden

• Nvidia bleibt der Industrieführer in KI-Hardware und betreibt das meiste globale Modelltraining und Inferenz.

• Google verwendet TPUs hauptsächlich in seiner eigenen Cloud und Modell-Pipeline, was interne Effizienz aber begrenzte Marktpräsenz bietet.

• OpenAI ist auf Nvidia-Hardware durch Microsoft Azure angewiesen und betreibt keine eigenen Chips.

Nvidia dominiert die globale Computing-Schicht, während Google sich darauf konzentriert, seinen internen KI-Stack effizient zu betreiben.

Entstehende Schlachtfelder: Cloud-Speicher und Energie

Da KI-Modelle skalieren, sind Speicherdurchsatz und Datenbewegung zu wichtigen Einschränkungen geworden. Google verbindet TPU-Trainingssysteme direkt mit seiner Speicherschicht, während AWS und Azure auf globale Datennetzwerke angewiesen sind, um zunehmend große Datensätze zu verarbeiten.

Dezentrale Speicher-Plattformen wie

Filecoin und

Arweave bieten auch verteilte Kapazität für nicht-echtzeitfähige Daten und fügen dem Speicher-Stack eine weitere Option hinzu.

Energie und Kühlung bestimmen jetzt, wie schnell KI-Cluster wachsen können. Google investiert in erneuerbare Energie, flüssigkeitsgekühlte TPU-Einrichtungen und erkundet

atomgestützte Grundlastquellen zur Unterstützung langfristiger Expansion. Nvidia verbessert weiterhin die GPU-Effizienz, während OpenAI auf Microsofts wachsenden Rechenzentrum-Fußabdruck angewiesen ist, der auch Interesse an atomgetriebener Infrastruktur einschließt. Diese Faktoren prägen zunehmend das Tempo, mit dem jedes Unternehmen KI-Systeme der nächsten Generation skalieren kann.

Wie man in Google-Aktien investiert: Eine Schritt-für-Schritt-Anleitung auf 3 verschiedene Arten

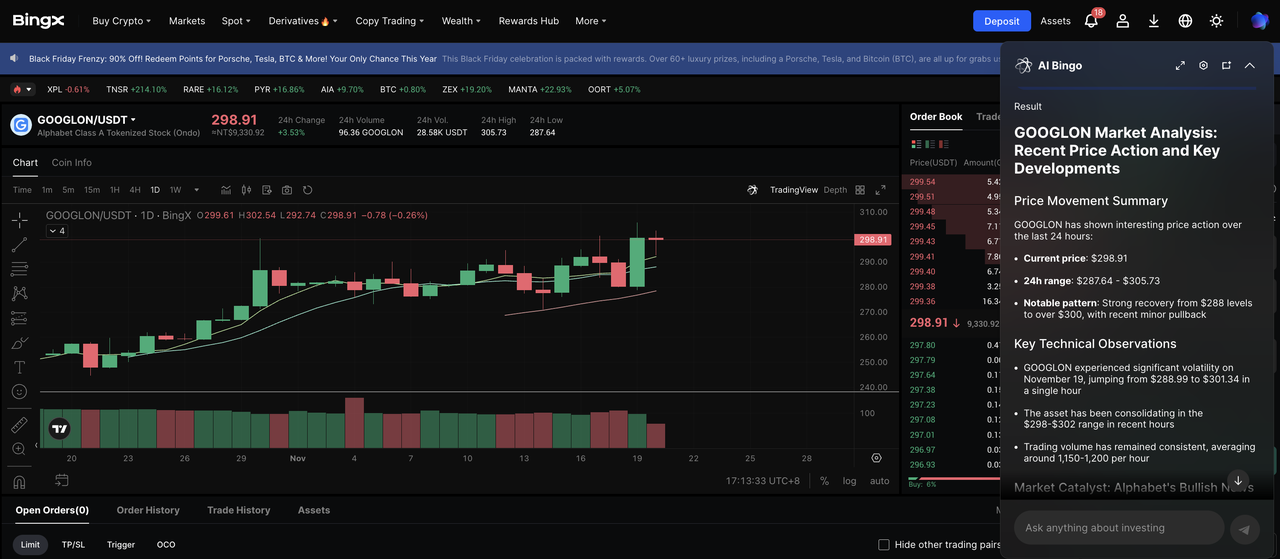

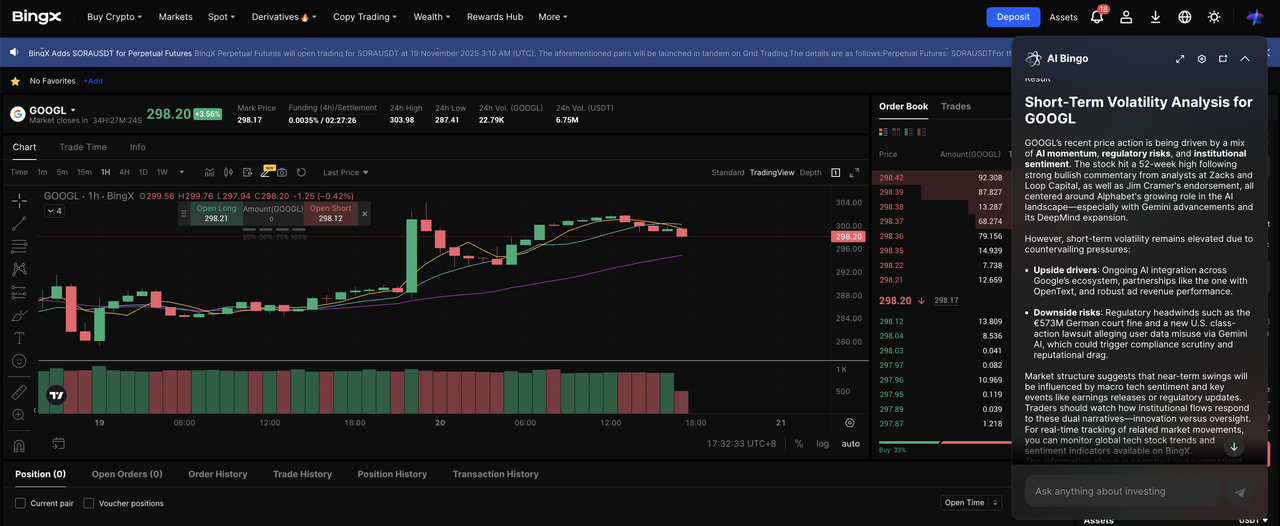

Investoren können sich Google über regulierte Aktienmärkte oder krypto-native Produkte auf BingX aussetzen. Unten sind drei klare Wege je nach Ihrer Präferenz für Zugang, Flexibilität oder Handelstools.

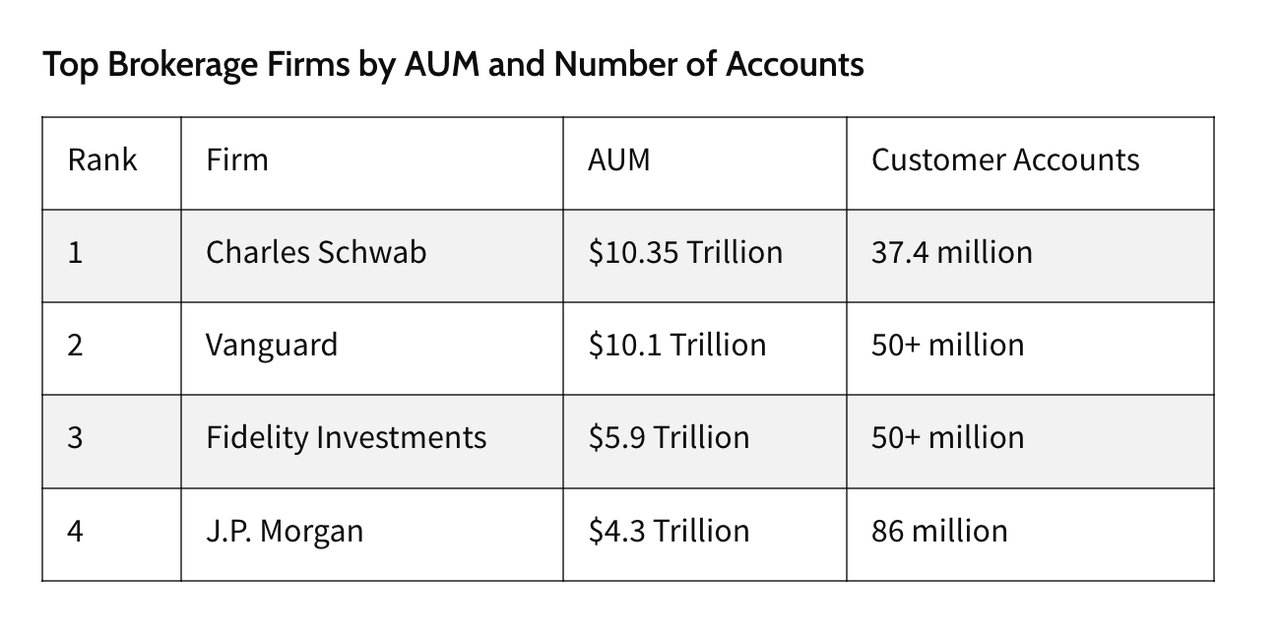

1. Alphabet-Aktien (GOOGL / GOOG) auf einer Broker-Plattform kaufen