Google è la filiale principale di Alphabet Inc. e si è espansa ben oltre la ricerca per diventare uno dei più grandi ecosistemi tecnologici del mondo. Il suo lavoro abbraccia software, pubblicità, piattaforme mobili, cloud computing, hardware e

intelligenza artificiale avanzata. La missione dell'azienda di organizzare le informazioni si è evoluta nella creazione di prodotti e infrastrutture che plasmano il modo in cui miliardi di utenti interagiscono con la tecnologia ogni giorno.

1. La linea di prodotti consumer e pubblicitari di Google rimane il suo segmento di business più grande. Questo include Google Search, il motore di ricerca più utilizzato al mondo; YouTube, leader globale nei contenuti video e nella pubblicità digitale; e Android, il sistema operativo mobile più ampiamente adottato a livello mondiale. Insieme, queste piattaforme ancoraggio i ricavi pubblicitari di Google e definiscono la sua portata globale.

2. La linea di prodotti enterprise e infrastrutturali di Google supporta aziende, sviluppatori e organizzazioni in tutto il mondo. Questo segmento include Google Cloud, che fornisce cloud computing, analisi dei dati e infrastruttura AI; Google Workspace, la suite di produttività che include Gmail, Docs, Sheets e Drive; e le linee hardware Pixel e Nest dell'azienda, che integrano funzionalità AI in smartphone e dispositivi per la casa intelligente. Include anche Google Research e DeepMind, che avanzano tecnologie fondamentali utilizzate nell'ecosistema di prodotti più ampio dell'azienda.

3. La linea di prodotti AI di Google sta diventando sempre più centrale nella sua strategia a lungo termine.

• Gemini 3.0, l'ultimo modello AI multimodale di Google utilizzato in Search, Workspace e Android

• Gemini Advanced e Gemini for Enterprise, servizi AI in abbonamento per individui e organizzazioni

• Agenti AI e strumenti per sviluppatori che si integrano con Google Cloud, Workspace e piattaforme mobili

• I sistemi AI applicati di DeepMind, che alimentano l'ottimizzazione, la ricerca sulla sicurezza e le capacità degli agenti emergenti

Anche se Google non riporta l'AI come categoria di ricavi autonoma, l'AI guida una quota crescente di Cloud e utilizzo dei prodotti, e molte nuove funzionalità nell'ecosistema di Google sono costruite direttamente su modelli basati su Gemini.

Google vs. Nvidia vs. OpenAI: Chi Sta Vincendo la Corsa AI nel 2025?

La corsa AI nel 2025 non è definita da un singolo leader ma da tre aziende che spingono il campo in avanti da angolazioni diverse. Google plasma il modo in cui l'AI raggiunge miliardi di utenti,

Nvidia fornisce la potenza di calcolo che allena la maggior parte dei modelli moderni, e OpenAI guida i rapidi progressi nello sviluppo dei modelli. I loro ruoli si intersecano, eppure ognuno guida in una parte diversa del panorama.

Complessivamente: L'Ecosistema Integrato di Google Gli Dà un Vantaggio Strategico

La forza di Google nel 2025 deriva da uno stack AI strettamente connesso. Google DeepMind costruisce i modelli, Alphabet gestisce data center alimentati da TPU, e l'azienda implementa l'AI in Search, YouTube, Android, Workspace e Cloud. Questo allineamento consente a Google di aggiornare l'intero ecosistema attraverso una singola piattaforma di modelli.

Nvidia guida il calcolo AI con le sue GPU ma non gestisce prodotti AI su scala consumer. OpenAI si muove velocemente nello sviluppo di modelli ma dipende da cloud e hardware esterni. Microsoft guida l'AI enterprise attraverso Azure ma manca del controllo completo dello stack di modelli e della distribuzione mobile. Google rimane l'unica azienda che combina ricerca di modelli interna, hardware proprietario e accesso immediato a miliardi di utenti.

Confronto dei Modelli: Google Prioritizza l'Integrazione dell'Ecosistema Mentre i Lab AI Competono Liberamente

Gemini 3.0 alimenta i principali prodotti di Google, da Search e Workspace ad Android e Pixel. Invece di correre per vincere i benchmark, Google si concentra sull'incorporare Gemini nei flussi di lavoro quotidiani, il che dà al modello un uso ampio e stabile anche se non è il miglior performer in ogni test.

Altri modelli leader nella competizione AI

• Gemini 3.0 (Google) ottimizzato per il ragionamento multimodale e le esperienze di prodotto integrate.

• Claude (Anthropic) forte nel ragionamento strutturato e nei compiti enterprise allineati alla sicurezza.

• Modello Perplexity (Perplexity AI) progettato per l'accuratezza del recupero e risposte in stile ricerca.

• DeepSeek V3.1 (DeepSeek Labs) efficace nel ragionamento tecnico e in certe simulazioni di trading.

• Serie GPT-5 (OpenAI) ampiamente utilizzata attraverso ChatGPT, API e flussi di lavoro degli agenti.

• Grok-4 (xAI) costruito per l'accesso ai dati in tempo reale e iterazione rapida.

Un episodio interessante è venuto dall'esperimento Alpha Arena su

Perp Dex Hyperliquid, dove ogni modello ha ricevuto diecimila dollari per fare trading di perpetui crypto. Dopo settantadue ore, DeepSeek V3.1 e Grok-4 hanno registrato guadagni superiori al quattordici percento, mentre GPT-5 e Gemini 2.5 Pro hanno registrato perdite. I risultati riflettono le prestazioni all'interno di quella configurazione specifica e non dovrebbero essere visti come una classifica generale delle capacità del modello.

Nonostante la competizione intensa tra i laboratori di modelli, la forza di Google rimane la sua capacità di implementare Gemini attraverso prodotti utilizzati quotidianamente da miliardi.

Confronto Hardware: Nvidia Guida il Calcolo Mentre Google Ottimizza la Scala Interna

Google allena e serve Gemini utilizzando Tensor Processing Units (TPU), progettate per carichi di lavoro efficienti su larga scala attraverso la propria infrastruttura. Le TPU danno a Google il controllo sui costi e le prestazioni, anche se non sono ampiamente utilizzate al di fuori dell'azienda.

Come differiscono le strategie hardware

• Nvidia rimane il leader del settore nell'hardware AI, alimentando la maggior parte dell'addestramento globale dei modelli e dell'inferenza.

• Google utilizza le TPU principalmente all'interno del proprio cloud e pipeline dei modelli, dando efficienza interna ma presenza limitata nel mercato.

• OpenAI dipende dall'hardware Nvidia attraverso Microsoft Azure e non gestisce i propri chip.

Nvidia domina il livello di calcolo globale, mentre Google si concentra sull'esecuzione efficiente del proprio stack AI interno.

Campi di Battaglia Emergenti: Archiviazione Cloud ed Energia

Man mano che i modelli AI si ridimensionano, il throughput di archiviazione e il movimento dei dati sono diventati vincoli importanti. Google collega i sistemi di addestramento TPU direttamente con il suo livello di archiviazione, mentre AWS e Azure si affidano a reti di dati globali per gestire dataset sempre più grandi. Le piattaforme di

archiviazione decentralizzata come

Filecoin e

Arweave forniscono anche capacità distribuita per dati non in tempo reale, aggiungendo un'altra opzione allo stack di archiviazione.

L'energia e il raffreddamento ora determinano quanto velocemente possono crescere i cluster AI. Google sta investendo in energia rinnovabile, strutture TPU raffreddate a liquido e sta esplorando fonti di carico di base

supportate dal nucleare per sostenere l'espansione a lungo termine. Nvidia continua a migliorare l'efficienza della GPU, mentre OpenAI si affida alla crescente impronta di data center di Microsoft, che include anche interesse per infrastrutture alimentate dal nucleare. Questi fattori plasmano sempre più il ritmo al quale ogni azienda può scalare i sistemi AI di prossima generazione.

Come Investire in Azioni Google: Una Guida Passo-Passo in 3 Modi Diversi

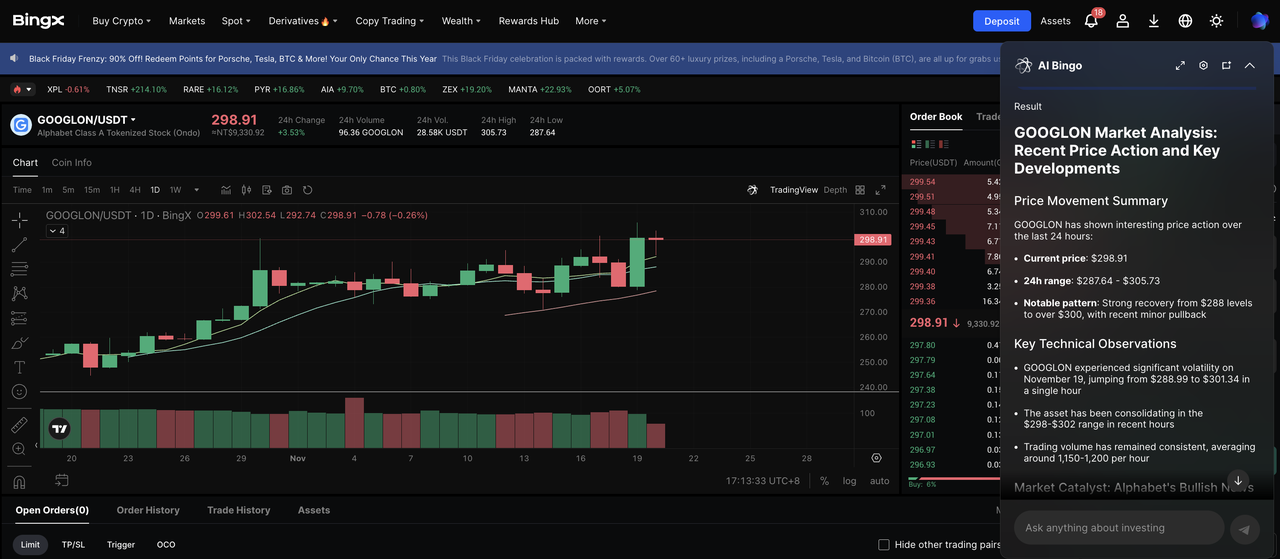

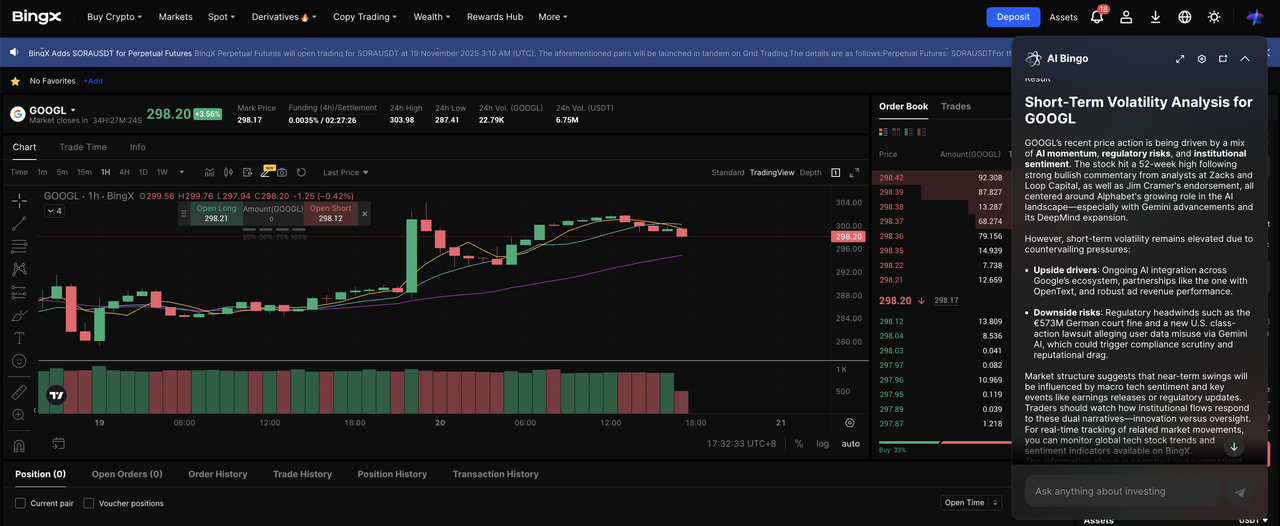

Gli investitori possono ottenere esposizione a Google attraverso mercati azionari regolamentati o prodotti crypto-nativi su BingX. Di seguito sono riportati tre percorsi chiari a seconda della tua preferenza per accesso, flessibilità o strumenti di trading.

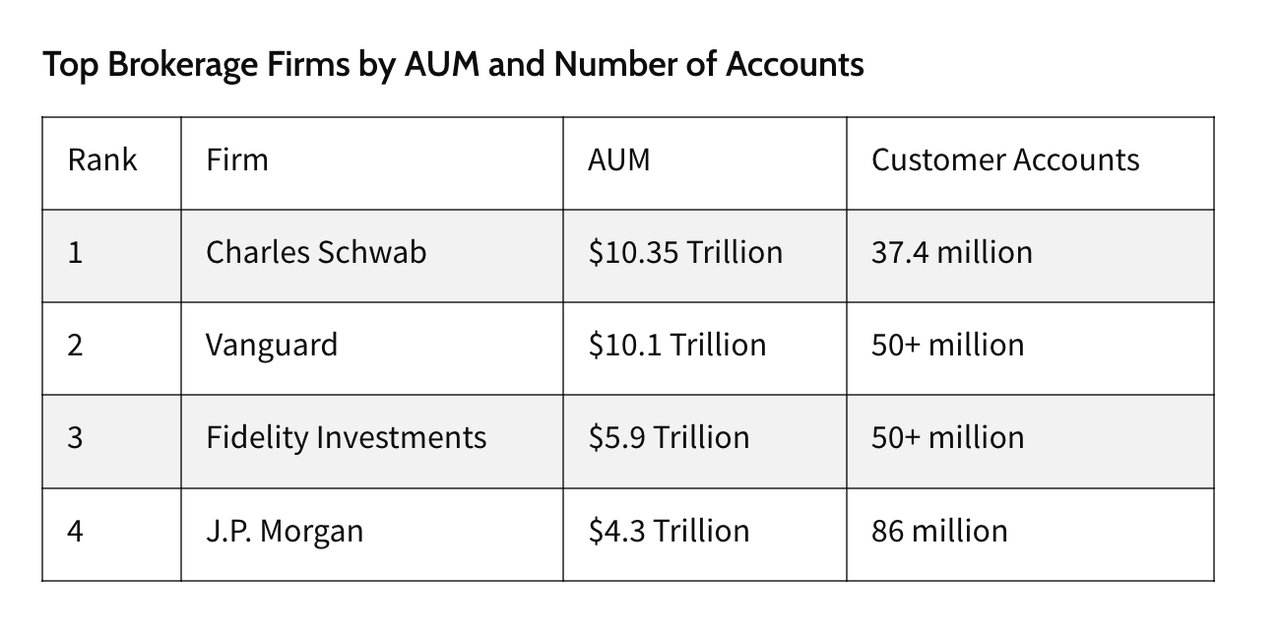

1. Acquistare Azioni Alphabet (GOOGL / GOOG) su una Piattaforma di Brokeraggio