Google to główna spółka zależna Alphabet Inc. i rozszerzyła się daleko poza wyszukiwanie, stając się jednym z największych ekosystemów technologicznych na świecie. Jej działalność obejmuje oprogramowanie, reklamę, platformy mobilne, chmurę obliczeniową, sprzęt i zaawansowaną

sztuczną inteligencję. Misja firmy polegająca na organizowaniu informacji przekształciła się w tworzenie produktów i infrastruktury, które kształtują sposób, w jaki miliardy użytkowników codziennie wchodzą w interakcję z technologią.

1. Linia produktów konsumenckich i reklamowych Google pozostaje jej największym segmentem biznesowym. Obejmuje to Wyszukiwarkę Google, najpowszechniej używaną wyszukiwarkę na świecie; YouTube, globalnego lidera w treściach wideo i reklamie cyfrowej; oraz Android, najszerzej przyjęty mobilny system operacyjny na świecie. Razem te platformy stanowią podstawę przychodów reklamowych Google i definiują jej globalny zasięg.

2. Linia produktów korporacyjnych i infrastrukturalnych Google wspiera firmy, deweloperów i organizacje na całym świecie. Ten segment obejmuje Google Cloud, które zapewnia chmurę obliczeniową, analitykę danych i infrastrukturę AI; Google Workspace, pakiet produktywności zawierający Gmail, Docs, Sheets i Drive; oraz linie sprzętowe Pixel i Nest firmy, które integrują funkcje AI w smartfonach i urządzeniach smart home. Obejmuje także Google Research i DeepMind, które rozwijają technologie fundamentalne używane w szerszym ekosystemie produktów firmy.

3. Linia produktów AI Google staje się coraz bardziej centralna dla jej długoterminowej strategii.

• Gemini 3.0, najnowszy multimodalny model AI Google używany w wyszukiwarce, Workspace i Androidzie

• Gemini Advanced i Gemini for Enterprise, subskrypcyjne usługi AI dla osób fizycznych i organizacji

• Agenci AI i narzędzia programistyczne integrujące się z Google Cloud, Workspace i platformami mobilnymi

• Systemy zastosowanej AI DeepMind, które napędzają optymalizację, badania nad bezpieczeństwem i nowe możliwości agentów

Chociaż Google nie raportuje AI jako osobnej kategorii przychodów, AI napędza rosnący udział w użyciu Cloud i produktów, a wiele nowych funkcji w ekosystemie Google jest budowanych bezpośrednio na modelach opartych na Gemini.

Google vs. Nvidia vs. OpenAI: kto wygrywa wyścig AI w 2025?

Wyścig AI w 2025 roku nie jest definiowany przez jednego lidera, ale przez trzy firmy pchające dziedzinę naprzód z różnych perspektyw. Google kształtuje sposób, w jaki AI dociera do miliardów użytkowników,

Nvidia dostarcza moc obliczeniową trenującą większość nowoczesnych modeli, a OpenAI napędza szybki postęp w rozwoju modeli. Ich role się przecinają, jednak każdy przewodzi w innej części krajobrazu.

Ogólnie: zintegrowany ekosystem Google daje mu przewagę strategiczną

Siła Google w 2025 roku wypływa z ściśle połączonego stosu AI. Google DeepMind buduje modele, Alphabet obsługuje centra danych oparte na TPU, a firma wdraża AI w wyszukiwarce, YouTube, Androidzie, Workspace i Cloud. To wyrównanie pozwala Google aktualizować cały swój ekosystem poprzez jedną platformę modelową.

Nvidia przewodzi w obliczeniach AI ze swoimi GPU, ale nie obsługuje produktów AI w skali konsumenckiej. OpenAI porusza się szybko w rozwoju modeli, ale zależy od zewnętrznej chmury i sprzętu. Microsoft napędza korporacyjną AI przez Azure, ale nie ma pełnej kontroli nad stosem modeli i dystrybucją mobilną. Google pozostaje jedyną firmą łączącą własne badania modelowe, zastrzeżony sprzęt i natychmiastowy dostęp do miliardów użytkowników.

Porównanie modeli: Google priorytetowo traktuje integrację ekosystemu, podczas gdy laboratoria AI konkurują swobodnie

Gemini 3.0 napędza główne produkty Google, od wyszukiwarki i Workspace po Androida i Pixele. Zamiast ścigać się o wygrane w benchmarkach, Google koncentruje się na osadzaniu Gemini w codziennych przepływach pracy, co daje modelowi szerokie, stabilne użycie, nawet jeśli nie jest najlepszym wykonawcą w każdym teście.

Inne wiodące modele w konkurencji AI

• Gemini 3.0 (Google) zoptymalizowany dla rozumowania multimodalnego i zintegrowanych doświadczeń produktowych.

• Claude (Anthropic) silny w ustrukturyzowanym rozumowaniu i zadaniach korporacyjnych zorientowanych na bezpieczeństwo.

• Model Perplexity (Perplexity AI) zaprojektowany dla dokładności wyszukiwania i odpowiedzi w stylu wyszukiwarki.

• DeepSeek V3.1 (DeepSeek Labs) skuteczny w rozumowaniu technicznym i niektórych symulacjach handlowych.

• Seria GPT-5 (OpenAI) szeroko używana przez ChatGPT, API i przepływy pracy agentów.

• Grok-4 (xAI) zbudowany dla dostępu do danych w czasie rzeczywistym i szybkich iteracji.

Jeden interesujący epizod pochodził z eksperymentu Alpha Arena na

Perp Dex Hyperliquid, gdzie każdy model otrzymał dziesięć tysięcy dolarów do handlu krypto perpetualami. Po siedemdziesięciu dwóch godzinach, DeepSeek V3.1 i Grok-4 odnotowały zyski powyżej czternastu procent, podczas gdy GPT-5 i Gemini 2.5 Pro zarejestrowały straty. Wyniki odzwierciedlają wydajność w tym konkretnym układzie i nie powinny być postrzegane jako ogólny ranking możliwości modelu.

Pomimo intensywnej konkurencji między laboratoriami modeli, siła Google pozostaje w jej zdolności do wdrażania Gemini w produktach używanych codziennie przez miliardy.

Porównanie sprzętu: Nvidia przewodzi w obliczeniach, podczas gdy Google optymalizuje skalę wewnętrzną

Google trenuje i obsługuje Gemini używając jednostek przetwarzania tensorowego (TPU), zaprojektowanych dla wydajnych obciążeń na dużą skalę w swojej własnej infrastrukturze. TPU dają Google kontrolę nad kosztami i wydajnością, chociaż nie są szeroko używane poza firmą.

Jak różnią się strategie sprzętowe

• Nvidia pozostaje liderem branży w sprzęcie AI, napędzając większość globalnego trenowania i wnioskowania modeli.

• Google używa TPU głównie w swojej własnej chmurze i pipeline modeli, dając wewnętrzną wydajność, ale ograniczoną obecność rynkową.

• OpenAI zależy od sprzętu Nvidia przez Microsoft Azure i nie obsługuje własnych chipów.

Nvidia dominuje w globalnej warstwie obliczeniowej, podczas gdy Google koncentruje się na wydajnym działaniu swojego wewnętrznego stosu AI.

Nowe pola bitew: przechowywanie w chmurze i energia

Gdy modele AI się skalują, przepustowość przechowywania i ruch danych stały się głównymi ograniczeniami. Google łączy systemy trenowania TPU bezpośrednio ze swoją warstwą przechowywania, podczas gdy AWS i Azure polegają na globalnych sieciach danych do obsługi coraz większych zbiorów danych.

Zdecentralizowane platformy przechowywania, takie jak

Filecoin i

Arweave również zapewniają rozproszoną pojemność dla danych niewymagających czasu rzeczywistego, dodając kolejną opcję do stosu przechowywania.

Energia i chłodzenie teraz determinują, jak szybko mogą rosnąć klastry AI. Google inwestuje w energię odnawialną, obiekty TPU chłodzone cieczą i eksploruje źródła obciążenia podstawowego

oparte na energii jądrowej w celu wsparcia długoterminowej ekspansji. Nvidia nadal poprawia wydajność GPU, podczas gdy OpenAI polega na rosnącym obszarze centrów danych Microsoft, który również obejmuje zainteresowanie infrastrukturą zasilaną energią jądrową. Te czynniki coraz bardziej kształtują tempo, w jakim każda firma może skalować systemy AI nowej generacji.

Jak inwestować w akcje Google: przewodnik krok po kroku na 3 różne sposoby

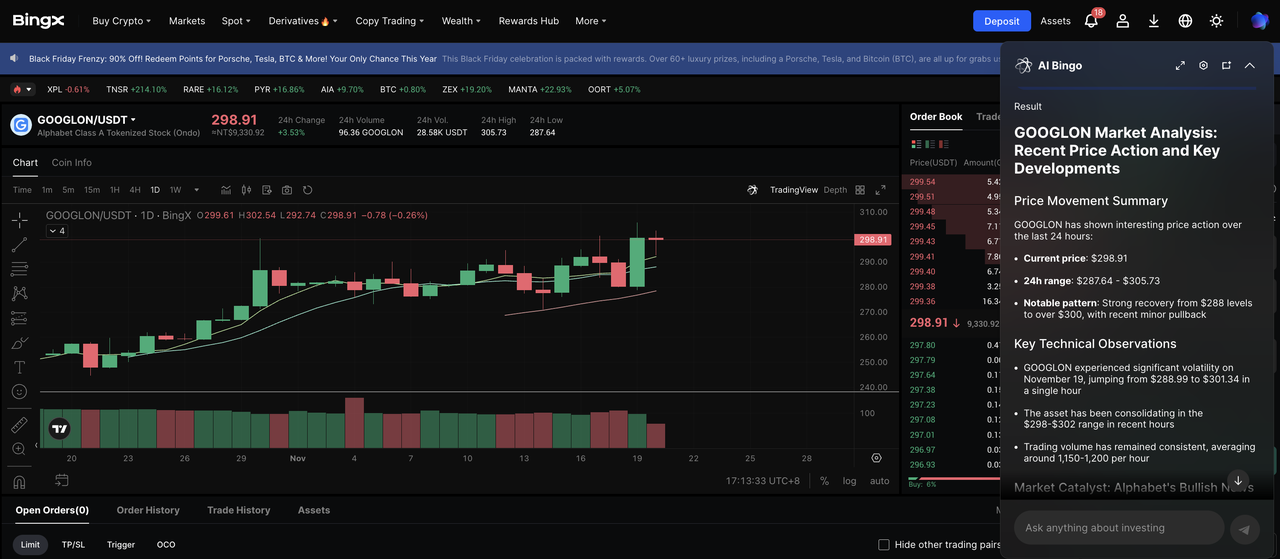

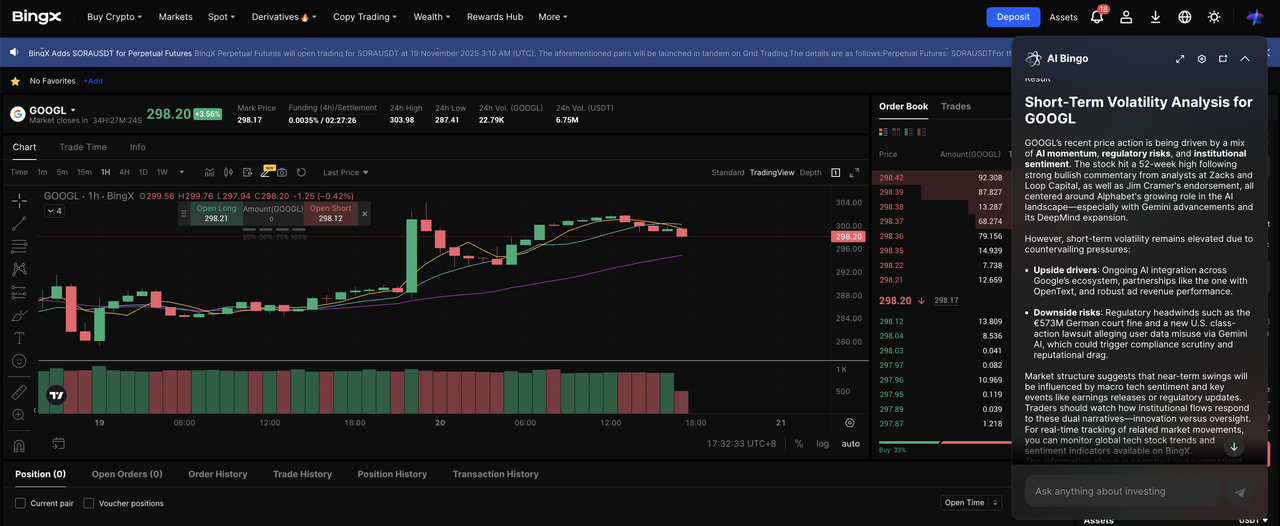

Inwestorzy mogą uzyskać ekspozycję na Google poprzez regulowane rynki akcji lub produkty natywne dla krypto na BingX. Poniżej znajdują się trzy jasne ścieżki w zależności od twoich preferencji co do dostępu, elastyczności lub narzędzi handlowych.

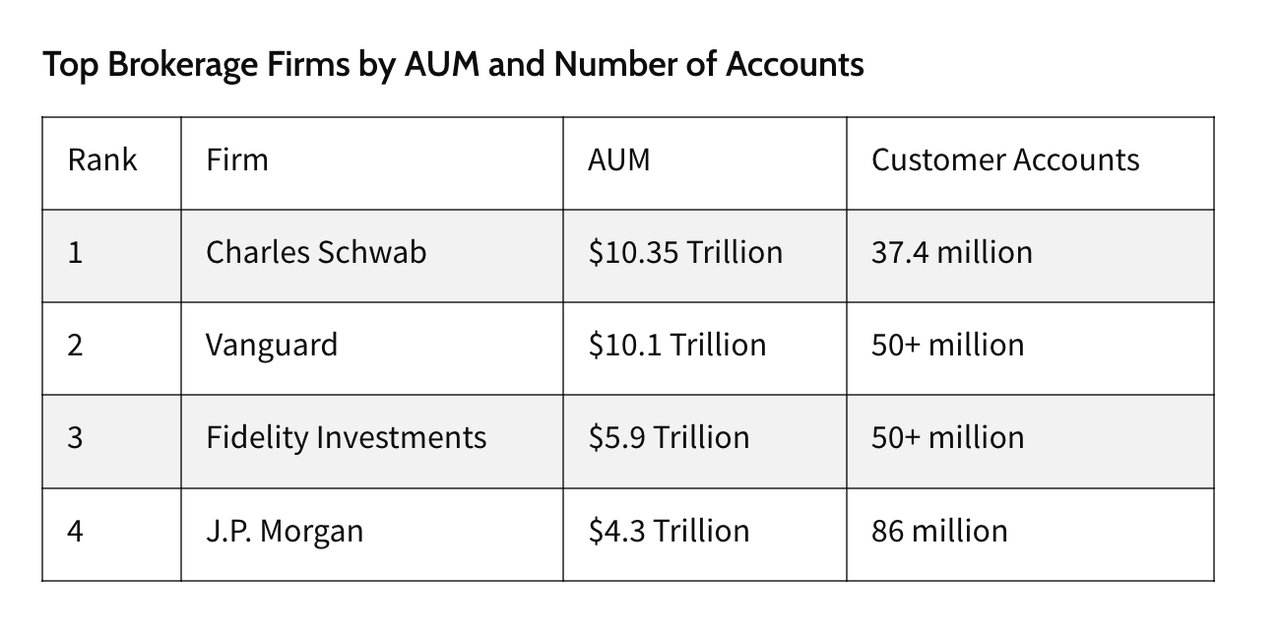

1. Kup akcje Alphabet (GOOGL / GOOG) na platformie brokerskiej