Google es la subsidiaria principal de Alphabet Inc. y se ha expandido mucho más allá de las búsquedas para convertirse en uno de los ecosistemas tecnológicos más grandes del mundo. Su trabajo abarca software, publicidad, plataformas móviles, computación en la nube, hardware e

inteligencia artificial avanzada. La misión de la empresa de organizar información ha evolucionado hacia la construcción de productos e infraestructura que dan forma a cómo miles de millones de usuarios interactúan con la tecnología todos los días.

1. La línea de productos de consumo y publicidad de Google sigue siendo su segmento de negocio más grande. Esto incluye Google Search, el motor de búsqueda más utilizado del mundo; YouTube, líder mundial en contenido de video y publicidad digital; y Android, el sistema operativo móvil más ampliamente adoptado a nivel mundial. Juntas, estas plataformas anclan los ingresos publicitarios de Google y definen su alcance global.

2. La línea de productos empresariales y de infraestructura de Google respalda a empresas, desarrolladores y organizaciones en todo el mundo. Este segmento incluye Google Cloud, que proporciona computación en la nube, análisis de datos e infraestructura de IA; Google Workspace, la suite de productividad que incluye Gmail, Docs, Sheets y Drive; y las líneas de hardware Pixel y Nest de la empresa, que integran funciones de IA en smartphones y dispositivos domésticos inteligentes. También incluye Google Research y DeepMind, que avanzan en tecnologías fundamentales utilizadas en el ecosistema de productos más amplio de la empresa.

3. La línea de productos de IA de Google se está volviendo cada vez más central en su estrategia a largo plazo.

• Gemini 3.0, el último modelo de IA multimodal de Google utilizado en Search, Workspace y Android

• Gemini Advanced y Gemini for Enterprise, servicios de IA por suscripción para individuos y organizaciones

• Agentes de IA y herramientas de desarrollador que se integran con Google Cloud, Workspace y plataformas móviles

• Sistemas de IA aplicada de DeepMind, que impulsan la optimización, investigación de seguridad y capacidades emergentes de agentes

Aunque Google no reporta la IA como una categoría de ingresos independiente, la IA impulsa una participación creciente del uso de Cloud y productos, y muchas características nuevas en el ecosistema de Google se construyen directamente sobre modelos basados en Gemini.

Google vs. Nvidia vs. OpenAI: ¿Quién está ganando la carrera de IA en 2025?

La carrera de IA en 2025 no se define por un solo líder, sino por tres empresas que impulsan el campo desde diferentes ángulos. Google da forma a cómo la IA llega a miles de millones de usuarios,

Nvidia suministra la computación que entrena la mayoría de los modelos modernos, y OpenAI impulsa el progreso rápido en el desarrollo de modelos. Sus roles se intersectan, pero cada uno lidera en una parte diferente del panorama.

General: El ecosistema integrado de Google le da una ventaja estratégica

La fortaleza de Google en 2025 proviene de una pila de IA estrechamente conectada. Google DeepMind construye los modelos, Alphabet opera centros de datos impulsados por TPU, y la empresa despliega IA en Search, YouTube, Android, Workspace y Cloud. Esta alineación permite a Google actualizar todo su ecosistema a través de una sola plataforma de modelos.

Nvidia lidera la computación de IA con sus GPU pero no opera productos de IA a escala de consumidor. OpenAI se mueve rápidamente en el desarrollo de modelos pero depende de la nube y hardware externos. Microsoft impulsa la IA empresarial a través de Azure pero carece de control total de la pila de modelos y distribución móvil. Google sigue siendo la única empresa que combina investigación de modelos interna, hardware propietario y acceso inmediato a miles de millones de usuarios.

Comparación de modelos: Google prioriza la integración del ecosistema mientras los laboratorios de IA compiten libremente

Gemini 3.0 impulsa los principales productos de Google, desde Search y Workspace hasta Android y Pixel. En lugar de competir por victorias en benchmarks, Google se enfoca en integrar Gemini en flujos de trabajo diarios, lo que le da al modelo un uso amplio y estable incluso si no es el mejor desempeño en cada prueba.

Otros modelos líderes en la competencia de IA

• Gemini 3.0 (Google) optimizado para razonamiento multimodal y experiencias integradas de productos.

• Claude (Anthropic) fuerte en razonamiento estructurado y tareas empresariales alineadas con la seguridad.

• Modelo Perplexity (Perplexity AI) diseñado para precisión de recuperación y respuestas estilo búsqueda.

• DeepSeek V3.1 (DeepSeek Labs) efectivo en razonamiento técnico y ciertas simulaciones de trading.

• Serie GPT-5 (OpenAI) ampliamente utilizado a través de ChatGPT, APIs y flujos de trabajo de agentes.

• Grok-4 (xAI) construido para acceso a datos en tiempo real y iteración rápida.

Un episodio interesante vino del experimento Alpha Arena en

Perp Dex Hyperliquid, donde cada modelo recibió diez mil dólares para hacer trading de perpetuos cripto. Después de setenta y dos horas, DeepSeek V3.1 y Grok-4 registraron ganancias por encima del catorce por ciento, mientras que GPT-5 y Gemini 2.5 Pro registraron pérdidas. Los resultados reflejan el rendimiento dentro de esa configuración específica y no deben verse como un ranking general de capacidad del modelo.

A pesar de la competencia intensiva entre laboratorios de modelos, la fortaleza de Google sigue siendo su capacidad de desplegar Gemini en productos utilizados diariamente por miles de millones.

Comparación de hardware: Nvidia lidera la computación mientras Google optimiza la escala interna

Google entrena y sirve Gemini usando Unidades de Procesamiento Tensor (TPU), diseñadas para cargas de trabajo eficientes a gran escala en su propia infraestructura. Las TPU dan a Google control sobre el costo y rendimiento, aunque no se utilizan ampliamente fuera de la empresa.

Cómo difieren las estrategias de hardware

• Nvidia sigue siendo el líder de la industria en hardware de IA, impulsando la mayoría del entrenamiento e inferencia de modelos globales.

• Google usa TPU principalmente dentro de su propia nube y pipeline de modelos, dando eficiencia interna pero presencia limitada en el mercado.

• OpenAI depende del hardware de Nvidia a través de Microsoft Azure y no opera sus propios chips.

Nvidia domina la capa de computación global, mientras Google se enfoca en ejecutar su pila de IA interna de manera eficiente.

Campos de batalla emergentes: Almacenamiento en la nube y energía

A medida que los modelos de IA escalan, el rendimiento de almacenamiento y el movimiento de datos se han convertido en limitaciones importantes. Google vincula los sistemas de entrenamiento TPU directamente con su capa de almacenamiento, mientras que AWS y Azure dependen de redes de datos globales para manejar conjuntos de datos cada vez más grandes. Las plataformas de

almacenamiento descentralizado como

Filecoin y

Arweave también proporcionan capacidad distribuida para datos no en tiempo real, agregando otra opción a la pila de almacenamiento.

La energía y refrigeración ahora determinan qué tan rápido pueden crecer los clústeres de IA. Google está invirtiendo en energía renovable, instalaciones TPU refrigeradas por líquido y explorando fuentes de carga base

respaldadas por energía nuclear para respaldar la expansión a largo plazo. Nvidia continúa mejorando la eficiencia de GPU, mientras que OpenAI depende de la creciente huella de centros de datos de Microsoft, que también incluye interés en infraestructura alimentada por energía nuclear. Estos factores dan forma cada vez más al ritmo al que cada empresa puede escalar sistemas de IA de próxima generación.

Cómo invertir en acciones de Google: Guía paso a paso de 3 maneras diferentes

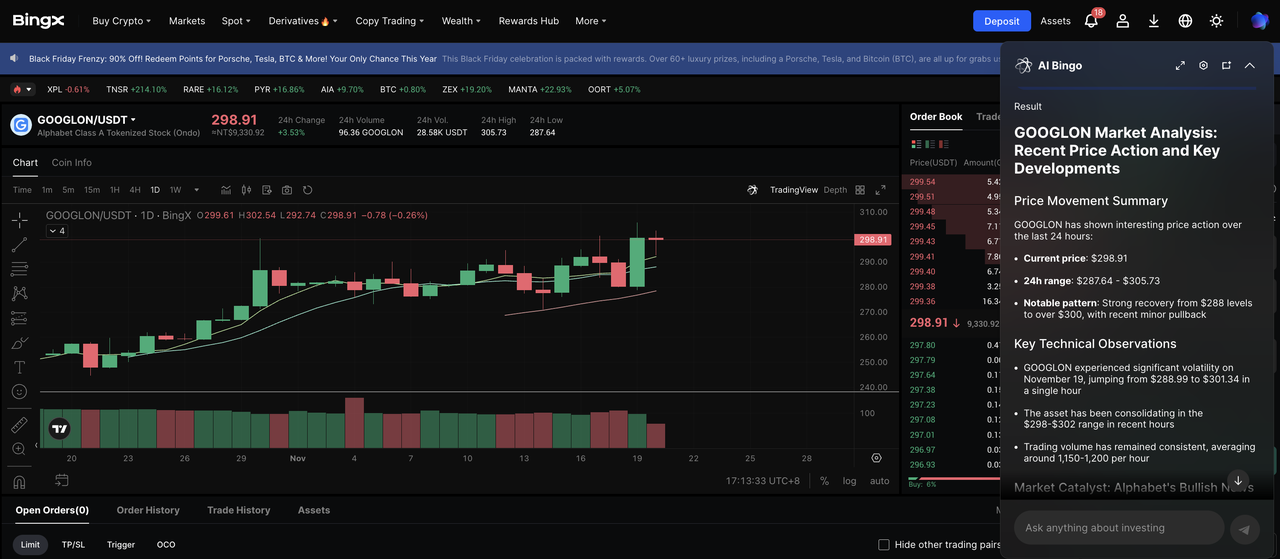

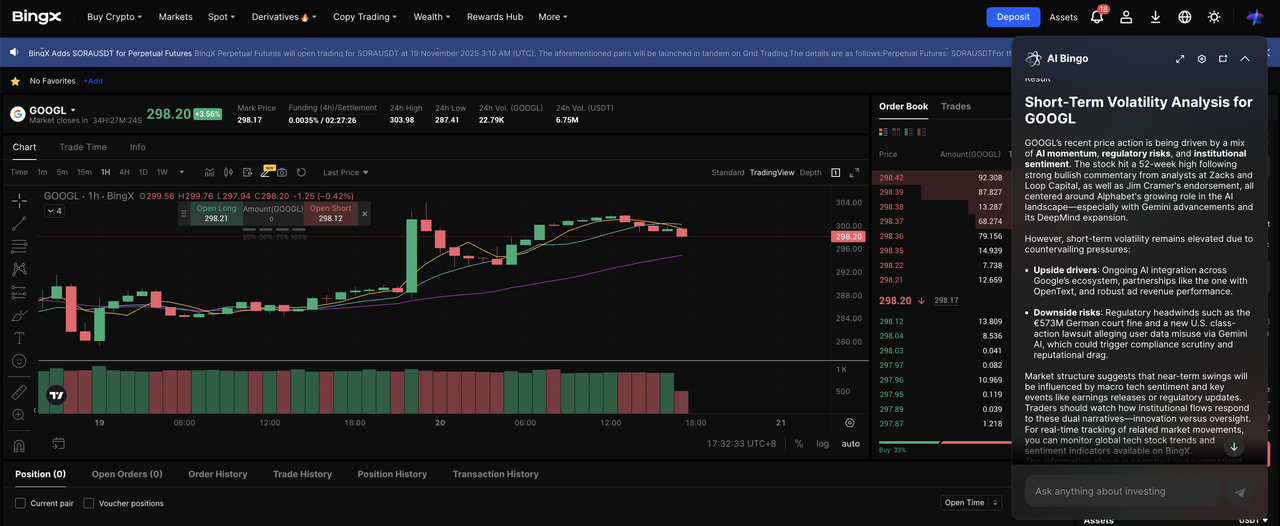

Los inversores pueden obtener exposición a Google a través de mercados de valores regulados o productos cripto nativos en BingX. A continuación se presentan tres rutas claras dependiendo de tu preferencia por acceso, flexibilidad o herramientas de trading.

1. Comprar acciones de Alphabet (GOOGL / GOOG) en una plataforma de corretaje